Video Boost with Night Sight a été annoncé en octobre 2023 aux côtés de la série Google Pixel 8. Le déploiement a commencé quelques semaines plus tard, et uniquement pour le modèle « Pro ». Il s'agit d'une technologie qui utilise l'IA pour améliorer considérablement les vidéos que vous capturez avec votre appareil Pixel.

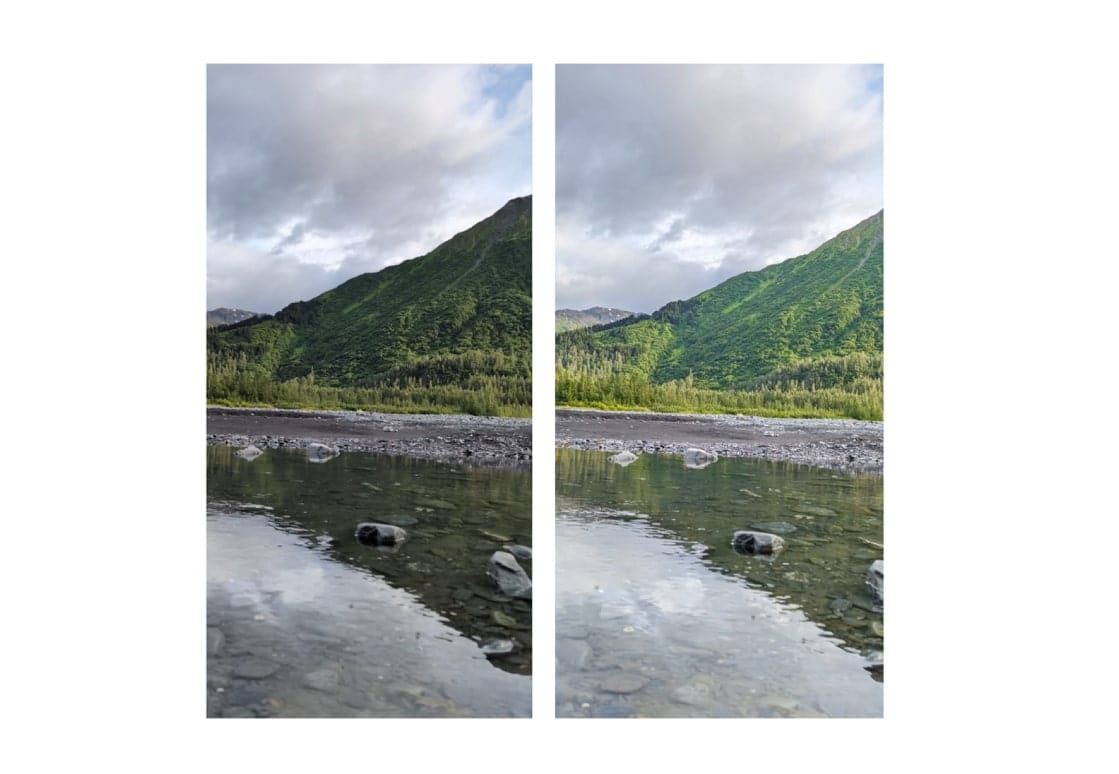

Les deux éléments de la technologie travaillent ensemble, chacun s’occupant de choses différentes. « Video Boost » se concentre sur l'amélioration de paramètres tels que la plage dynamique, le contraste, les couleurs, la stabilisation et le niveau de détail. D'autre part, « Night Sight » est l'implémentation dans les vidéos de la fonction que l'application Google Camera propose depuis longtemps pour les photos.

Dans le dernier épisode Made by Google Podcast, la société a offert plus de détails sur le développement de Video Boost avec Night Sight. L’équipe a révélé ce qu’elle recherchait exactement avec cette technologie. Ils ont également évoqué les principales difficultés rencontrées tout au long de leur parcours.

L'objectif de Google lors du développement de Video Boost avec Night Sight

L’objectif principal de Google était de «débloquez la meilleure qualité vidéo jamais vue sur un smartphone.» Les appareils Pixel sont connus pour leurs photos de haute qualité, mais l'enregistrement vidéo n'a jamais été au même niveau. Ils vont donc désormais chercher à équilibrer la qualité entre photo et vidéo sur leurs téléphones.

Concernant l’exclusivité de la fonctionnalité sur le Pixel 8 Pro, ils ont déclaré qu’ils étaient «je viens de commencer sur le Pixel 8 Pro pour faire cela pour nos utilisateurs.» Bien qu'il ne s'agisse pas d'une confirmation officielle de quoi que ce soit, cela ouvre la porte à Video Boost avec Night Sight pour atteindre davantage d'appareils Pixel à l'avenir.

Les défis rencontrés par l’équipe de développement

Concernant les défis rencontrés, ils ont évoqué la puissance de traitement des smartphones. Une différence clé entre Night Sight pour les photos et Night Sight pour la vidéo réside dans la manière dont elles sont traitées. Alors que pour les photos, le traitement est effectué sur l'appareil, pour les vidéos, ils s'appuient sur la puissance de l'IA basée sur le cloud. En effet, les smartphones manquent encore de puissance pour un traitement vidéo local complexe.

Ce n'est pas surprenant, puisque cette tâche peut être compliquée même pour les ordinateurs de bureau. Rappelons que les fichiers vidéo sont exponentiellement plus longs et plus complexes que les photos. Concernant l'utilisation du cloud pour le traitement vidéo, l'équipe de Google a déclaré ce qui suit :

«Nous pouvons donc décider combien d'images nous voulons aligner et fusionner, et comment allons-nous les fusionner. Nous pouvons même amener cela à un autre niveau. Nous pouvons même faire bien mieux. Nous pouvons même exécuter simultanément des algorithmes plus complexes. Par exemple, nous pouvons effectuer un déflou. Nous pouvons procéder à la stabilisation. Nous pouvons effectuer une correction des couleurs.

Si le recours au cloud pour le traitement présente l'avantage de pouvoir exploiter toute la puissance des serveurs de Google, cela signifie également que vous ne pouvez pas utiliser la fonctionnalité sans connexion Internet.

Pour couronner le tout, un autre grand défi a été le calibrage du traitement pour éviter tout type de problème dans le résultat final. Autrement dit, ils devaient trouver comment éviter les décalages de temps entre l'audio et la vidéo, les aberrations chromatiques, le scintillement aléatoire ou les effets similaires. Après tout, personne ne voudrait utiliser un outil qui génère constamment des résultats inutilisables.