Le boom de l'intelligence artificielle a surpris l'industrie technologique. La mise en œuvre de l'IA a entraîné de nombreux résultats positifs, tels que des progrès importants dans les technologies clés et le développement d'outils impressionnants qui semblaient auparavant impossibles. Cependant, cela a également apporté des défis qui, des années plus tard, sont toujours recherchés correctement. Les méthodes d'escroquerie ou les tromperies basées sur les fascines profondes alimentées en AI occupent une place privilégiée sur la liste des plus inquiétantes.

L'une des principales vertus de l'IA est celle qui, à son tour, a également créé l'un des plus grands inconvénients. Nous parlons de l'augmentation du rythme du développement dans l'industrie de la technologie. Bien que cela soit positif pour l'industrie en soi, il a mis les régulateurs dans une obligation. Les mêmes sociétés d'IA ont également été prises dans le problème car elles n'ont pas toutes d'outils qui leur permettent d'identifier avec précision quand un fichier est unfake Deep et informer l'utilisateur.

Qu'est-ce qu'unfake Deep?

Peut-être que vous n'êtes toujours pas entièrement clair sur ce qu'est unfake Deep. Fondamentalement, c'est le contenu généré par les modèles d'IA où le visage ou le corps d'une personne est modifié numériquement, généralement en le superposant à celui de quelqu'un d'autre. De cette façon, la victime semble impliquée dans des situations où elle ne l'a jamais été. Cela s'applique également aux fichiers audio où les acteurs malveillants «clonent» la voix de quelqu'un pour leur faire dire ce qu'ils veulent.

Dans les bonnes mains, ces types d'outils sont très utiles et vous permettent d'exploiter votre créativité au maximum. Cependant, comme l'IA Deepfakes sont devenus de plus en plus réalistes, les acteurs malveillants ont commencé à les utiliser pour leurs escroqueries.

Initialement, il y avait des erreurs évidentes dans les images générées par l'AI, ce qui les rend faciles à identifier à l'œil humain. Il vous suffit de regarder des choses comme les doigts; Oui, dessiner des mains est difficile même pour les AIS puissants. Cependant, à mesure que les modèles d'IA génératifs ont évolué, la sortie est devenue de plus en plus réaliste. Aujourd'hui, de nombreuses images générées par l'IA sont indiscernables de la réalité. En fait, nous pourrions dire que vous pouvez plus facilement identifier les illustrations générées par l'IA qu'une image ou une vidéo photoréaliste générée par l'IA.

Des outils DeepFake sont désormais disponibles pour tout le monde, pour le meilleur et pour le pire

Comme si cela ne suffisait pas, les entreprises ne sont pas satisfaites des outils de génération d'images. Ces dernières années, nous avons même vu des modèles de génération vidéo avec des résultats impressionnants. Ce mois-ci, Bytedance – Parent Company of Tiktok – a lancé un modèle de génération vidéo d'IA avec les résultats les plus réalistes que nous ayons jamais vus. Le modèle, appelé Omnihuman-1, promet que la vidéo Deepfakes jusqu'à 10x mieux qu'auparavant. Nous parlons d'un saut générationnel incroyable en qualité, et nous verrons des choses comme celle-ci chaque année. Ci-dessous, vous pouvez voir un petit exemple de ce dont Omnihuman-1 est capable.

La Chine est sur 🔥 Bytedance laisse tomber un autre papier de banger AI!

Omnihuman-1 peut générer des vidéos humaines réalistes à n'importe quel rapport d'aspect et proportion corporelle en utilisant une seule image et audio. C'est le meilleur que j'ai vu jusqu'à présent.10 exemples incroyables et la liaison du papier de recherche👇 pic.twitter.com/5ojnj0797t

– Ashutoshshrivastava (@AI_FOR_SUCCESS) 4 février 2025

L'amélioration de la démocratisation de Deepfakes et d'outils d'IA a conduit davantage de personnes à utiliser ces plateformes. Les étudiants peuvent les trouver utiles pour obtenir des images complémentaires pour des projets ou des présentations. Les artistes peuvent obtenir l'inspiration pour commencer à travailler. Vous pouvez également générer une image juste pour vous amuser avec des amis.

Mais que se passe-t-il lorsque des acteurs malveillants entrent en jeu? Déception, manipulation, extorsion… essentiellement toutes les formes d'escroqueries qui existaient déjà, mais qui ont été beaucoup plus faciles par Ai Deepfakes.

Incidents liés à des tentatives d'escroquerie profonde alimentées par l'IA

Il y a eu d'innombrables cas d'arnaques dans plusieurs contextes où les profondeurs AI ont été les protagonistes. Ressemble.ai a une énorme base de données d'incidents liés à l'utilisation de l'IA générative. Parmi les cas les plus récents figurent la promotion des actions ou des actifs cryptographiques en utilisant le visage et la voix de l'investisseur Vijay Kedia. Il est également très courant d'utiliser l'image d'Elon Musk dans des vidéos où il promeut censément une crypto-monnaie. Pratiquement toutes les chaînes YouTube piratées montrent la même vidéo avec « Elon Musk » essayant d'escroquer les gens en demandant de l'argent ou des cryptos.

Un autre risque majeur lié à Deepfakes est les cas potentiels de sextorsion. C'est une pratique où des tiers malveillants créent de faux nus pour essayer de faire chanter les gens en menaçant de les répandre publiquement ou de les envoyer à leurs familles. Les adolescents sont généralement la principale cible de ces situations, car ils sont plus susceptibles d'interagir avec des étrangers sur les réseaux sociaux. Des plates-formes telles que Instagram ont pris des mesures pour essayer d'arrêter ce type d'interaction. Cependant, l'exposition de l'adolescent commence au moment où ils décident de discuter avec un étranger sur les réseaux sociaux.

Il y a aussi ceux qui utilisent Deepfakes pour essayer de manipuler l'opinion publique. Ces cas ont généralement plusieurs origines, bien qu'ils dérivent souvent de la sphère politique. Par exemple, les mauvais acteurs peuvent manipuler des vidéos pour encourager le vote pour ou contre un candidat lors d'une élection. Ces vidéos peuvent essayer de faire en sorte qu'un candidat particulier soit mauvais ou, au contraire, les rendre extrêmement beaux aux yeux des gens.

De même, il y a des cas où les gens utilisent des images ou des vidéos DeepFake comme outil pour répandre la haine. Il existe des cas de multimédia manipulés pour essayer de créer une aversion contre une communauté ou un groupe particulière. Ces vidéos peuvent montrer aux gens dire quelque chose qu'ils n'ont jamais dit ou faire des choses qu'ils n'ont jamais faites.

L'identité est une autre possibilité à l'ère de l'IA grâce à la puissance de Deepfake. Ressemble.ai répertorie un cas de la mi-février où les escrocs ont usurpé l'identité des détenteurs de réclamations légitimes. Les outils d'IA leur ont permis de créer des vidéos réalistes qui se font l'identité d'autres, leur permettant de voler environ 5,6 millions de dollars d'actifs. Dans ce cas, les escrocs avaient également des données personnelles sur les victimes, probablement obtenues par l'ingénierie sociale. Par conséquent, ce scénario combine le risque de DeepFakes avec la nécessité de protéger toutes vos informations personnelles.

Les gens recherchent de plus en plus des moyens de détecter DeepFakes

Il y a d'innombrables cas de faux profonds utilisés pour essayer de tromper, d'escroquer ou de menacer. Ainsi, les gens devraient être de plus en plus prudents quant au contenu multimédia qu'ils voient sur Internet. En fait, la préoccupation croissante se reflète déjà dans les statistiques. Recherches en ligne liées à «Images DeepFake«A augmenté de 15% dans le monde en 2024. Les pointes se sont produites juste après que des nouvelles de canuèges ou d'escroqueries en utilisant des vidéos ou des images alimentées par l'IA ont émergé. Certains des termes de recherche connexes les plus populaires étaient «Comment détecter les images DeepFake » et « Images réelles vs générées par l'AI. » Ainsi, la préoccupation croissante des gens est réelle.

Les tentatives de canular ou d'escroqueries basées sur les tas de l'IA sont susceptibles d'augmenter à partir de maintenant. De nos jours, même les smartphones ont des applications qui permettent de générer ce type de contenu. De plus, le smartphone lui-même est un appareil qui facilite la diffusion de vidéos ou d'images manipulées. Cela en fait une épée à double tranchant à l'ère de l'intelligence artificielle.

Même vous pourriez agir en tant que «mauvais acteur» – sans vraiment être un – inconsciemment. Il n'est pas nécessaire que vous soyez le seul à créer un fichier DeepFake particulier. Tout ce que vous avez à faire est de recevoir une image, une vidéo ou un audio manipulées et la partager avec vos contacts ou sur vos réseaux sociaux comme s'il était réel. Ce n'est souvent pas à 100% de votre faute, car, comme nous l'avons déjà dit, le contenu DeepFake peut être extrêmement réaliste.

Pour éviter les cas où vous agissez comme un «disséminateur defake profondément» sans le savoir ou tomber dans les escroqueries potentielles promues par de mauvais acteurs – ce qui pourrait même mettre votre sécurité en danger – les entreprises a été axées sur les entreprises. Après tout, ils offrent les outils pour créer ce type de contenu. Ainsi, ils ont également la responsabilité intrinsèque de faciliter les moyens de le détecter.

Les «références de contenu» et «synthédiques» cherchent à stimuler la transparence à l'ère de l'IA générative

L'industrie technologique n'est pas restée statique face à cette situation. Les incidents indésirables croissants liés aux Fakes Deepfakes ont conduit à la naissance de la coalition pour la provenance et l'authenticité du contenu (C2PA). De ce comité en question est né les «références de contenu», une norme qui cherche la transparence à l'ère de l'IA générative. Les «informations d'identification de contenu» intègrent et identifie essentiellement des métadonnées spécifiques aux images gérées par l'IA pour les identifier en tant que telles.

Bien que cela semble simple et rapide à mettre en œuvre, il n'a pas été jusqu'à présent. En effet, les fabricants d'appareils et les développeurs d'IA doivent adopter la norme. Cela rend le processus lent, en particulier par rapport au rythme de l'évolution des capacités d'intelligence artificielle. L'année dernière, Sony a lancé la caméra phare Alpha 1 II avec la prise en charge des informations d'identification de contenu. La dernière série Samsung Galaxy S25 est également compatible avec la norme.

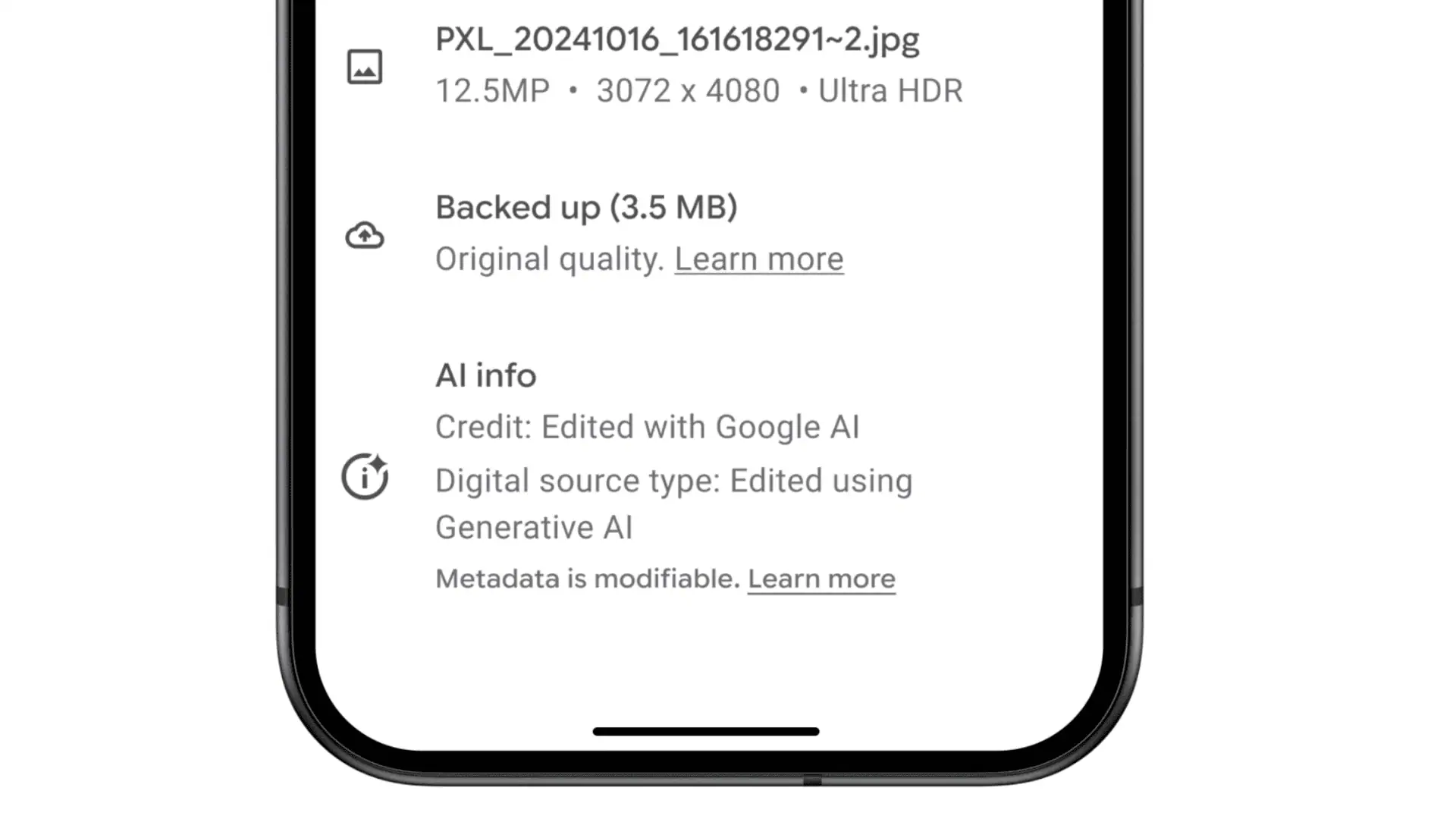

À la mi-septembre 2024, Google a annoncé son entrée au comité C2PA. Le géant de Mountain View contribuera ses ressources et son expérience pour tenter d'étendre la gamme d'outils qui facilitent la transparence à l'ère de l'IA. Google a «synthétique» comme son propre système pour identifier le contenu modifié à l'aide d'outils alimentés par l'IA. En fait, ce mois-ci, la société a annoncé que les photos générées par «Reimagine», la fonctionnalité de Magic Editor Suite de Google Photos, proposera un filigrane synthétique de l'IA. Le «filigrane de l'IA» sera disponible dans la section «Info AI» dans les détails de la photo / vidéo.

Cela dit, SynthID est une norme moins capable que les informations d'identification de contenu. Actuellement, dans l'industrie des smartphones, Samsung a pris les devants en transparence concernant DeepFakes en intégrant les informations d'identification de contenu nativement. Aucune autre marque de téléphone n'a fait cela jusqu'à présent, c'est donc un grand pas. Il reste à voir si les informations d'identification de contenu viendront sur des appareils Galaxy plus anciens via des mises à jour logicielles.

Conseils pour éviter de tomber amoureux d'une arnaque Deepfake AI

Bien que de nombreux Fakes profonds puissent être indiscernables de la réalité, vous pouvez prendre des étapes pour éviter d'être victimes d'eux. La première consiste à rester sceptique quant au contenu des médias impliquant des personnalités publiques. Si un acteur promeut une fausse crypto-monnaie ou si un politicien est dans une situation surréaliste, votre première réaction devrait être de douter de l'authenticité du fichier.

Si le contenu proviendrait d'une personnalité publique particulière, vérifiez leurs poignées sur les réseaux sociaux. Souvent, des vidéos de personnalités publiques proviennent de leurs propres comptes de médias sociaux. Si vous ne trouvez pas le contenu sur leurs comptes de médias sociaux, restez vigilant. Vous devez également activer les fonctionnalités d'identification de contenu AI sur votre appareil et vos applications. Il y a des cas où ces outils sont activés par défaut, mais aussi d'autres où ils ne le sont pas.

Enfin, il existe également des outils de détection DeepFake sur lesquels vous pouvez vous tourner. Bien qu'ils puissent échouer de temps en temps, ils sont généralement assez efficaces. Il existe plusieurs plates-formes similaires disponibles, à la fois publiquement et exclusives à un système ou à un matériel particulier. Scanner Deepware est celui que vous pouvez utiliser librement par vous-même à partir d'un navigateur. D'autres, comme DuckDuckGoose, Intel Fakecatcher et Reality Defender, sont conçus en pensant aux entreprises.

En bref, les fesses profondes propulsées par l'IA sont là pour rester, mais ce n'est pas nécessairement une mauvaise chose. Les capacités impressionnantes de l'intelligence artificielle sont également très utiles pour stimuler la productivité, rechercher une inspiration supplémentaire, optimiser le flux de travail, gagner du temps et libérer votre créativité. Cependant, vous devez être conscient du contexte dans lequel nous sommes et être plus vigilants sur la façon dont vous gérez le contenu que vous consommez sur Internet.

Espérons que les développeurs d'IA et les développeurs d'outils d'IA adopteront des normes telles que les références de contenu. Ce serait une grande aide pour le grand public, en particulier les moins avertis en technologie.