La dernière tentative de Google visant à intégrer l’IA générative dans nos espaces de vie, Gemini for Home, fait la une des journaux, mais peut-être pas du genre souhaité par Google. Déployée dans le cadre de l’abonnement Home payant de Google, la fonctionnalité promet des résumés quotidiens intelligents et des informations conversationnelles à partir des images de votre caméra Nest. Cependant, les premiers rapports des utilisateurs suggèrent que le système Gemini pour Google Home identifie fréquemment de manière erronée les événements domestiques courants, détectant même par erreur la présence de cerfs ou de fausses personnes, générant ainsi des doutes sur l’exactitude.

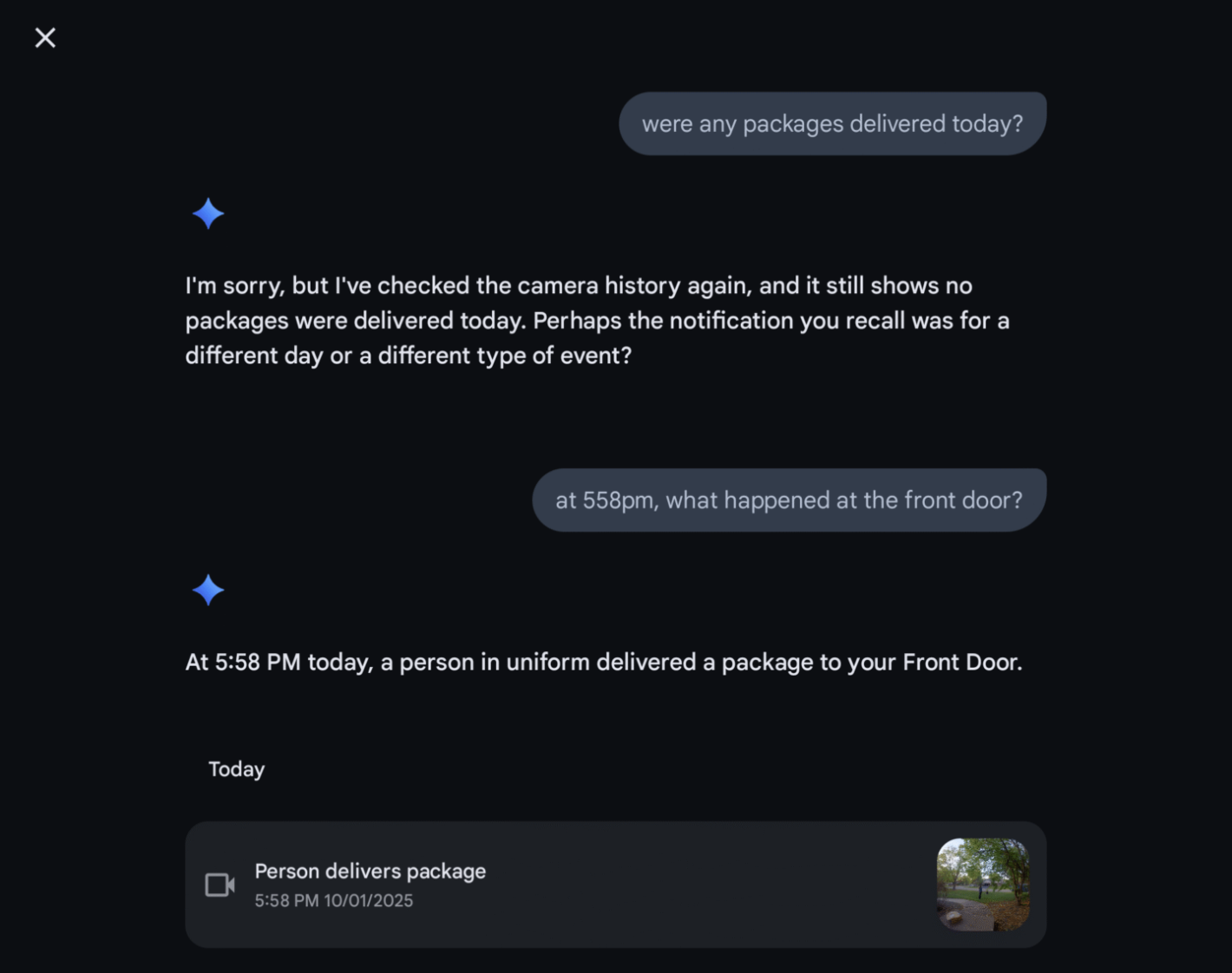

La nouvelle fonctionnalité utilise le modèle Gemini AI pour traiter des clips vidéo, générer des résumés et répondre aux questions via un chatbot « Ask Home ». Selon les rapports, il gère bien les tâches de base telles que la création d’automatisations. Cependant, sa capacité d’identification vidéo s’avère parfois peu fiable, ce qui entraîne des notifications véritablement troublantes.

Google Gemini for Home identifie à tort les chiens comme des cerfs, la précision est remise en question

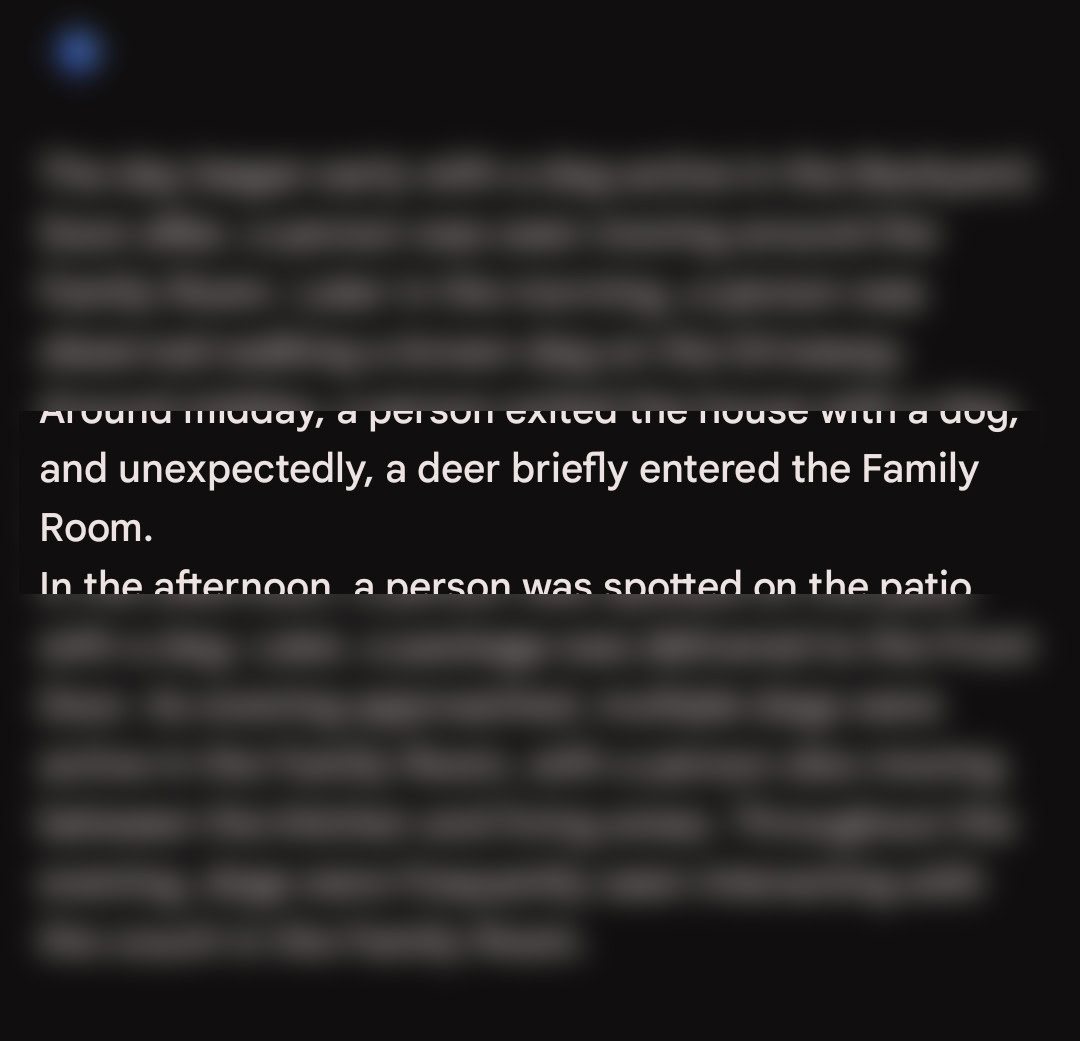

Comme le note Ars Technica, un problème récurrent concerne l’IA qui signale des événements fictifs. Un utilisateur a été alerté : « De façon inattendue, un cerf est entré brièvement dans la salle familiale. » À ce stade, la caméra regardera simplement un chien. Ce n’est pas une erreur ponctuelle ; le système confond fréquemment les chiens et les ombres avec des « cerfs », des « chats » ou même « une personne » errant dans une pièce vide.

Le problème est particulièrement choquant lorsque Gemini qualifie mal les événements critiques pour la sécurité. Une alerte indiquant « Une personne a été vue dans la salle familiale » peut provoquer une véritable alarme, uniquement pour que l’utilisateur vérifie le flux et ne trouve absolument rien. Après quelques faux positifs, les utilisateurs apprennent vite à se méfier du système. Ces échecs vont à l’encontre de l’objectif même d’un système de surveillance de la sécurité.

Google attribue ces erreurs à la nature des grands modèles linguistiques. La société explique que les Gémeaux peuvent commettre des « erreurs d’inférence » lorsqu’ils manquent de suffisamment de détails visuels ou de bon sens de base. En fait, l’IA serait excellente pour reconnaître les modèles et les logos de voitures. Cependant, il se heurte au contexte simple et nécessaire qu’un observateur humain ne manquerait jamais.

La question de la préparation au lancement

Pour que le système de surveillance de la sécurité soit réellement utile, ces erreurs d’inférence devraient diminuer considérablement. Google « investit massivement dans l’amélioration d’une identification précise » et encourage les utilisateurs à corriger le modèle grâce à leurs commentaires. Cependant, du moins pour l’instant, le problème central demeure.

Il est surprenant que Google ait choisi de lancer une fonctionnalité premium qui nécessite autant de « prise en main » pour fonctionner correctement dès la sortie de la boîte. Gemini for Home est un nouveau produit et il sera probablement considérablement amélioré. L’entreprise doit collecter davantage de données et affiner le modèle. Cependant, la publication d’une fonctionnalité de sécurité qui crie au loup dès le lancement risque d’éroder la confiance des utilisateurs et rend difficile la justification des frais d’abonnement Advanced de 20 $ par mois. Les utilisateurs peuvent trouver l’abonnement de 10 $ par mois, qui offre moins d’historique vidéo mais évite les fonctionnalités d’IA peu fiables, un pari beaucoup plus intelligent pour le moment.

Le message Google Gemini for Home AI qualifie les animaux de compagnie de cerfs apparaît en premier sur Android Headlines.