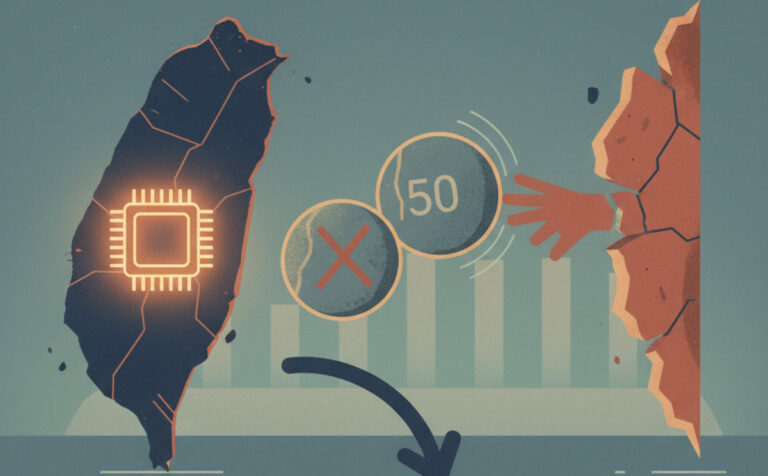

Les relations entre les sociétés d’IA et l’armée américaine entrent dans une nouvelle phase tendue. Au centre de la tempête se trouve Anthropic, la startup basée à San Francisco connue pour son orientation vers la « sécurité de l’IA ». Selon un récent rapport d’Axios, le Pentagone menace actuellement de rompre son partenariat de 200 millions de dollars avec Anthropic en raison d’un désaccord clé : quel contrôle une entreprise privée devrait avoir sur la façon dont l’armée utilise ses logiciels, comme les modèles d’IA de Claude.

L’ultimatum de 200 millions de dollars : pourquoi le Pentagone menace d’abandonner l’accord sur l’IA anthropique

Depuis des mois, le ministère de la Défense (DoD) pousse quatre acteurs majeurs de l’IA – Anthropic, OpenAI, Google et xAI – à autoriser l’armée à utiliser leurs modèles à « toutes fins légales ». Cela signifie essentiellement lever les garde-fous standards qui empêchent les utilisateurs ordinaires d’appliquer l’IA à des domaines sensibles comme le développement d’armes, la collecte de renseignements ou les opérations sur le champ de bataille.

Les rapports suggèrent qu’OpenAI, Google et xAI ont fait preuve d’un certain degré de flexibilité. L’anthropique, en revanche, serait le plus résistant. L’entreprise a tracé une ligne dure à deux limites spécifiques : l’utilisation de son modèle Claude pour la surveillance de masse des Américains et le développement d’armes entièrement autonomes, des systèmes capables de tirer sans qu’un humain soit impliqué.

Tensions suite au raid de Maduro

Les frictions ont atteint un point d’ébullition après l’opération militaire américaine visant à capturer l’ancien président vénézuélien Nicolas Maduro. Le Wall Street Journal a rapporté que le Pentagone avait utilisé Claude pendant la mission via un partenariat avec la société de données Palantir. Cet incident a soulevé des questions internes chez Anthropic.

Les responsables de la défense ont exprimé leur frustration lorsqu’Anthropic aurait demandé si leur technologie était impliquée dans le raid, au cours duquel des « tirs cinétiques » (combat) ont eu lieu. Le Pentagone considère ce type de surveillance comme irréalisable. L’entité fait valoir que les combattants ne peuvent pas s’arrêter pour négocier des cas d’utilisation individuels avec un fournisseur de logiciels pendant leurs opérations actives.

Un choc culturel

Le conflit met en évidence un choc culturel important. Les responsables cités par Axios ont décrit Anthropic comme le plus « idéologique » des laboratoires d’IA. L’entreprise serait régie par une politique d’utilisation interne stricte qui provoque même une « inquiétude interne » parmi ses propres ingénieurs concernant le travail militaire. Cependant, le Pentagone est confronté à un dilemme : malgré les frictions, les responsables admettent que Claude est actuellement en avance sur ses concurrents dans les applications gouvernementales spécialisées et les applications classifiées.

Si les deux parties ne parviennent pas à parvenir à un accord, le Pentagone a suggéré qu’il pourrait qualifier Anthropic de « risque pour la chaîne d’approvisionnement ». Il pourrait également rechercher un remplacement ordonné. Pour sa part, Anthropic affirme son engagement en faveur de la sécurité nationale. La société d’IA souligne qu’elle a été la première entreprise à mettre des modèles sur des réseaux classifiés. Pour l’instant, les deux parties discutent encore.